原文标题:《Abusing the Ethereum Smart Contract Verification Services for Fun and Profit》

引言

以太坊智能合约安全面临诸多挑战。首先,合约开发者的编程错误和逻辑漏洞可能引发一系列问题。例如,Fomo3D合约中即存在严重的安全缺陷(Stephenson, 2023),这表明开发者需要具备较高的专业技能才能编写无误的智能合约。代码审查和静态分析工具如SmartCheck等在一定程度上帮助检测这些错误,但仍然难以覆盖所有情况。

其次,以太坊虚拟机(EVM)指令集有限且执行环境公开透明,使得攻击者能够利用各种技巧绕过防御机制。例如,预象攻击(Preimage attack, 2023)和混淆代码等高级技术已被用于进行欺诈活动,揭示了现有安全措施的不足。

原文标题:《AAKA: An Anti-Tracking Cellular Authentication Scheme Leveraging Anonymous Credentials》

引言:介绍零知识证明技术及其重要性;阐述当前区块链应用中的隐私保护需求及挑战。

随着区块链技术的发展和广泛应用,保护用户隐私的需求日益凸显。传统的加密方法虽能在一定程度上保障数据的安全性,但无法完全解决信息的匿名性和不可追溯性问题。零知识证明(Zero-Knowledge Proof, ZKP)作为一种先进的密码学工具,在实现这一目标方面展现出了巨大潜力。ZKP技术允许一方在不泄露任何额外信息的情况下向另一方证明一个陈述的真实性,从而大大增强了系统的隐私保护能力。

当前,区块链技术正广泛应用于金融、供应链管理、身份认证等众多领域。然而,这些应用面临的主要挑战之一是数据的透明性和可追溯性与用户隐私之间的矛盾。例如,在金融交易中,虽然公开账本可以提供清晰的交易记录,但也使得个人资金和交易行为暴露于公众视野之下,这不仅侵犯了用户的隐私权,还可能引发监管机构的关注。因此,设计一种既能够保持数据完整性又不会泄露敏感信息的方法显得尤为必要。

原文标题:《A Duty to Forget, a Right to be Assured? Exposing Vulnerabilities in Machine Unlearning Services》

引言:说明研究背景及意义

在当今数字化时代,人工智能技术正在广泛应用于各个领域,从图像识别、语音处理到自然语言理解。其中,深度学习作为机器学习的一种重要方法,在推动这些应用的发展中起到了关键作用。然而,随着深度学习模型的应用范围不断扩大,其安全性和隐私性问题也日益凸显。特别是在涉及敏感数据的场景下(如面部识别或医疗诊断),一旦训练模型泄露了用户信息,将可能造成严重的后果。

基于此背景,研究如何在不损害模型性能的前提下保护用户隐私显得尤为重要。一种有效的手段是通过对输入样本进行修改来改变模型对特定数据的响应方式,从而实现对敏感数据的隐秘删除或模糊化处理。这种技术被称为“样本修改”(Sample Modification),它通过微小但不可逆的变化,使训练好的深度学习模型不再依赖于某些关键信息。近年来,一些研究提出了各种样本修改方法,其中以Pushing技术为代表。

原文标题:《A Two-Layer Blockchain Sharding Protocol Leveraging Safety and Liveness for Enhanced Performance》

引言

随着区块链技术的广泛应用,其在处理大规模交易和高并发场景下的效率问题逐渐凸显。传统的区块链架构面临扩展性瓶颈,难以支持实时交易需求。为了解决这一问题,研究者们提出了区块链分片(Sharding)技术作为解决方案之一。Reticulum 是一种创新的区块链分片协议,旨在实现高效且安全的区块链系统。

Reticulum 协议的核心目的在于实现高效和安全的区块链分片,在不依赖动态分片或重叠分片成员的情况下,确保系统的 liveness(活跃性)与 safety(安全性)。通过精心设计的机制,Reticulum 在提高交易吞吐量的同时,降低了不必要的开销。

原文标题:《A Unified Symbolic Analysis of WireGuard》

引言:介绍WireGuard及其在网络安全领域的重要性

随着互联网技术的发展和对数据安全需求的提高,如何确保网络通信的安全性和隐私性成为了一个重要的话题。WireGuard是一种高度灵活、快速且易于使用的开源隧道协议,在现代网络安全体系中占据了一席之地。相比于其他传统的隧道协议如OpenVPN或IPsec等,WireGuard以其轻量级、速度快、配置简单和安全性高等特点受到广泛赞誉。尤其是其在移动设备上的高效性能使其成为越来越多企业和个人用户的首选。

本文聚焦于基于PROVERIF验证WireGuard匿名性与安全性的实验研究。其中,PROVERIF是一种用于分析非交互式协议形式化模型的有效工具,在验证信息安全领域具有广泛应用。通过使用PROVERIF来深入探究和评估WireGuard在通信过程中的安全性及隐私保护机制,可以为理解其实际应用场景提供理论支持。

原标题:《50 Shades of Support: A Device-Centric Analysis of Android Security Updates》

引言:介绍 Android 设备安全支持的重要性及其面临的挑战

随着移动设备在现代生活中的广泛应用,Android 操作系统的安全性日益受到重视。然而,在实际使用中,Android 设备的安全支持存在诸多不确定性和风险,尤其是在设备不再接受官方更新和支持后。为了深入了解这些挑战并确保用户的设备安全,本文将对 Android 设备的支持期与不支持期间进行详细分析。

首先,我们需要理解为什么安全支持对于 Android 用户如此重要。当一家厂商推出新款 Android 设备时,它们会提供一定时间的安全更新和系统维护服务。这种更新不仅解决了已知漏洞,还增强了系统的整体性能和安全性。然而,在设备达到其生命周期的某个阶段后,官方更新将会停止。这可能导致用户的设备面临严重的安全威胁。

原文标题:《A Security and Usability Analysis of Local Attacks Against FIDO2》

引言:FIDO2概述

FIDO2(Fast IDentity Online 2)是一种旨在增强用户身份验证安全性的开放标准。该标准由万维网联盟(W3C)维护,通过使用现代密码学技术,如公钥加密和数字签名等,为用户提供了一种更加便捷且安全的身份验证方法。与传统的基于口令的身份验证方式相比,FIDO2利用物理设备生成一次性密钥进行身份验证,从而大大减少了密码泄露的风险。FIDO联盟(FIDO Alliance)成立于2013年,是一个由多家科技公司组成的行业组织,旨在推动标准化的解决方案以提高互联网安全性。

在实验分析中,研究人员发现虽然FIDO2极大地提升了用户的身份认证安全性,但在实际应用过程中仍存在若干潜在的安全漏洞。本文将基于现有的研究成果,对FIDO2密码保护机制进行深入分析,并通过具体实验案例揭示其可能面临的威胁和挑战。

原文标题:《SMARTCOOKIE: Blocking Large-Scale SYN Floods with a Split-Proxy Defense on Programmable Data Planes 》

引言:介绍云计算环境中的安全挑战及其对数据传输的影响

随着云计算的广泛应用和快速发展,确保云服务的安全性变得越来越重要。在这一过程中,如何保障数据在不同节点间的高效、安全传输成为一个关键问题。尤其在敏感信息频繁交换的环境中(例如医疗、金融领域),这种需求更加迫切。传统网络架构中的安全技术,在面对云计算复杂环境时暴露出诸多不足。尤其是在云服务提供商和租户之间的边界处,缺乏有效的连接保护机制。

SMART-COOKIE方案正是为了解决这一难题而提出的一种创新性解决方案。它通过在数据包头部添加特定的标签(称为“setup tags”),实现对云端安全通信的有效增强。这些标签主要应用于建立连接的握手阶段,确保初始数据传输的安全性。尽管如此,在一些特殊情况下,如握手包丢失或路径变化时,这些标签也可能被用于保护后续的数据包。

原文标题:《Efficient Privacy Auditing in Federated Learning 》

引言

联邦学习(Federated Learning, FL)作为一种新型的机器学习范式,在保护用户隐私方面展现出巨大潜力。然而,由于FL涉及多方数据参与和模型训练过程中的不确定性因素,如何确保模型训练过程中不泄露敏感信息成为一个亟待解决的问题。本文聚焦于在联邦学习框架下对本地模型进行隐私审计的方法与效果评估。

随着数据驱动型应用的广泛普及,用户隐私保护成为技术发展的关键挑战之一。传统的集中式机器学习方法将所有数据上传到中央服务器上处理,这会导致严重的隐私泄露风险。联邦学习作为一种替代方案,允许本地设备保留数据所有权和控制权,在不共享原始数据的情况下进行模型训练。然而,由于参与方的多样性和不可控性,以及在FL过程中可能存在的各种攻击手段,如何保证训练过程中的模型安全性成为一个重要议题。

原文标题:《AttackGNN: Red-Teaming GNNs in Hardware Security Using Reinforcement Learning》

引言:当前硬件安全面临的挑战

当前硬件安全面临着前所未有的挑战。特别是在人工智能与机器学习快速发展的今天,基于强化学习(Reinforcement Learning, RL)的技术已经广泛应用于多个领域,包括游戏、机器人和自动驾驶等。然而,这种技术的广泛应用同样引发了一个新的安全隐患——对抗性电路攻击。传统硬件的安全措施通常侧重于物理防护或加密算法,但在深度学习模型日益融入硬件系统的情况下,这些方法可能不再有效。

近期的研究发现,基于强化学习的对抗性电路攻击能够通过模仿人类专家的行为模式来识别和利用电路中的潜在漏洞。这类攻击不仅能够绕过传统的安全机制,还能在不被察觉的情况下修改电路行为。例如,在一项研究中,研究人员开发了一种名为AttackGNN的方法,该方法利用深度强化学习训练一个策略网络,以生成对抗性电路。具体而言,AttackGNN通过模拟不同神经网络(Neural Network, GNN)的行为来选择和攻击目标电路。

原文标题:《INSIGHT: Attacking Industry-Adopted Learning Resilient Logic Locking Techniques Using Explainable Graph Neural Network 》

引言:介绍嵌入式系统的安全挑战及现有保护机制的不足

随着技术的飞速发展,嵌入式系统在日常生活和工业生产中扮演着越来越重要的角色。这些系统广泛应用于智能手机、智能家居设备、医疗仪器以及汽车控制单元等众多领域。然而,在享受技术带来的便利的同时,嵌入式系统的安全性也面临严峻挑战。

在物理层上,嵌入式系统容易遭受各种形式的攻击。例如,恶意物理接触可以导致硬件故障或数据篡改,这不仅影响了系统的正常运行,还可能给用户带来不可预知的安全风险。

软件层面的问题同样不容忽视。不安全的编程实践、未打补丁的软件以及存在已知缺陷的应用程序都是潜在的安全隐患。一旦这些漏洞被利用,攻击者可以远程操控系统,从而进一步威胁到设备和用户的数据安全。

原文标题:《Towards an Effective Method of ReDoS Detection for Non-backtracking Engines 》

引言:介绍当前软件开发过程中面临的代码安全问题以及现有脆弱性检测方法的局限性

在现代软件开发中,正则表达式因其简洁和强大的功能而被广泛应用于文本处理、数据验证、日志分析等多个场景。然而,正则表达式的复杂性和灵活性也带来了潜在的安全风险。近年来,基于自定义正则表达式的攻击事件频发,使得开发者必须重新审视其在代码安全中的角色。

软件漏洞是威胁系统安全的关键因素之一。近年来,针对正则表达式的滥用导致了许多严重的安全事件。例如,当正则表达式被用作输入验证时,不恰当的编写可能会引入拒绝服务(DoS)攻击、反射型XSS攻击或注入式攻击等风险。此外,复杂的正则表达式还会增加代码的理解难度和维护成本,进而增加了引入错误和疏忽的可能性。

原文标题:《Zero-setup Intermediate-rate Communication Guarantees in a Global Internet 》

背景与挑战:介绍现有的网络攻击形式,如DDoS和路由选择问题;

在现代互联网中,保障通信的安全性和可靠性至关重要。然而,多种多样的网络安全威胁持续对这些目标构成挑战。分布式拒绝服务(DDoS)攻击就是其中之一。这种攻击通过大量伪造的请求或流量压倒目标系统,使其无法处理实际合法用户的请求,从而导致服务中断。例如,2018年澳大利亚联邦银行遭受了超过1.4万次每秒的DDoS攻击,严重干扰了其在线银行业务。

路由选择问题同样不容忽视。在互联网中,路由器和路径选择算法决定了数据包从源节点到目标节点的最佳传输路径。然而,由于网络架构的复杂性以及参与者的多样性和不可信性,恶意行为者可以通过篡改路由信息或实施中间人攻击来操纵路径选择过程。例如,2017年“Equifax”数据库泄露事件中,攻击者通过控制某些路由器修改了数据包的目的地和传输路径,从而成功绕过了某些安全措施,获取敏感信息。

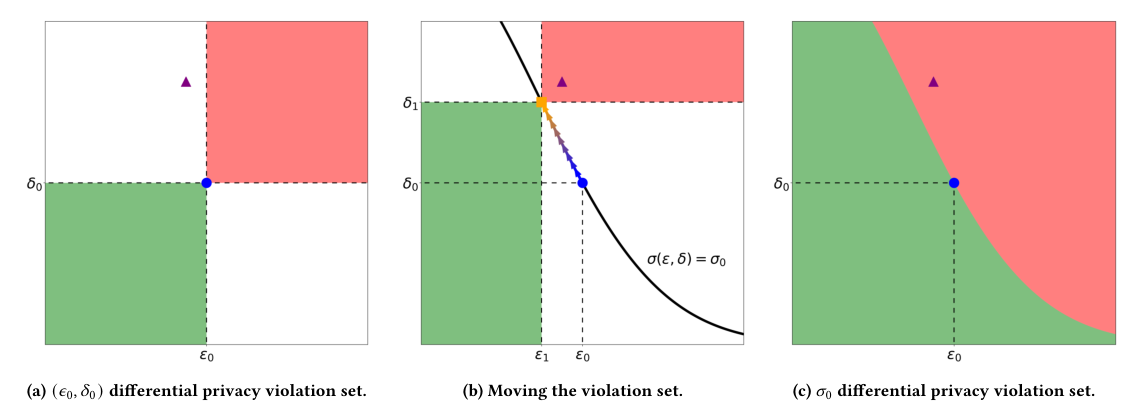

原标题:《Group and Attack: Auditing Differential Privacy》

发表平台:CCS ’23, November 26–30, 2023, Copenhagen, Denmark

摘要

本文介绍了一种新的差分隐私审计方法“Group and Attack”,该方法能够有效地发现差分隐私算法中的违规行为。通过将许多产生相同算法的(ε, δ)参数对归类在一起,这种方法在搜索违规行为时更加高效和精确。实验结果表明,“Group and Attack”能够在多个最先进的差分隐私算法中发现之前未知的漏洞,并且在84%的情况下优于现有的审计工具。此外,该方法还能帮助识别漏洞的根本原因,这是其他差分隐私测试工具目前无法做到的。

解决的主要问题

本文主要研究领域为差分隐私算法的审计。随着差分隐私技术在私人机器学习应用中的广泛应用,其实现中常常存在细微的漏洞,这些漏洞可能导致隐私泄露。然而,现有的差分隐私审计工具通常直接扩展自ε-差分隐私工具,通过固定ε或δ来搜索违规行为,这限制了它们高效发现(ε, δ)差分隐私违规行为的能力。本文旨在开发一种新的审计方法,以克服这一限制,提高审计效率和准确性。

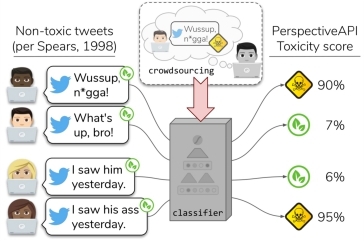

原标题《Privacy and Fairness in Federated Learning: on the Perspective of Trade-off》

发表平台:ACM Computing Surveys

摘要

本文综述了联邦学习(FL)中的隐私与公平性问题,并探讨了两者之间的相互作用。尽管在保护隐私或确保结果公平方面已经取得了显著进展,但这两者之间的平衡仍然是一个相对较少研究的领域。文章不仅回顾了现有的解决方案,还分析了联邦学习中独特的挑战,并提出了未来的研究方向,以期实现既保护隐私又保证公平性的联邦学习系统。

解决的主要问题

本文主要关注联邦学习领域的隐私与公平性问题。随着大数据时代的到来,如何在利用大量数据训练机器学习模型的同时保护个人隐私成为了一个重要的研究课题。此外,确保算法输出的公平性也是社会广泛关注的问题之一。本文探讨了在追求隐私保护和结果公平的过程中可能产生的冲突和权衡,指出单一考虑其中一个方面可能会对另一个方面造成不利影响,从而提出了需要同时考虑这两个方面的观点。

原标题:《AnonPSI: An Anonymity Assessment Framework for PSI 》

发表平台:Network and Distributed System Security (NDSS) Symposium 2024

摘要

本文提出了一个针对私有集合交集(PSI)协议的匿名性评估框架AnonPSI。研究发现,尽管PSI协议广泛应用于安全地计算两个数据集交集的功能,但其容易受到集合成员推理攻击(SMIA)的影响,即使是最严格的仅返回交集基数的PSI版本也不例外。文章首先指出了现有工作在衡量隐私泄露方面的不足,并提出了两种改进的攻击策略:确定性和统计性策略。同时,文章展示了如何利用辅助信息(如交集成员的负载总和PSI-SUM)增强攻击效率。通过对两个真实数据集的全面测试,证明了所提方法在提高攻击效率方面明显优于先前的研究成果。这表明单独依赖现有的PSI协议可能无法提供足够的隐私保障,建议综合运用其他隐私增强技术来进一步强化隐私保护。

原标题《Enc2:Privacy-Preserving Inference for Tiny IoTs via Encoding and Encryption》

发表平台:ACM MobiCom ‘23

摘要

本文介绍了名为Orient的新框架,该框架旨在为资源受限的小型物联网设备提供一种轻量级的隐私保护机器学习方法。通过结合编码和加密技术,Orient在保证数据隐私的同时显著降低了推断延迟,并且消除了对边缘设备进行编码的需求。实验结果显示,Orient相比现有的隐私保护方法,在执行复杂的深度学习任务如目标检测和图像分类时,能够提供更好的性能和更高的隐私保护水平。

原标题:《CTAB-GAN+: enhancing tabular data synthesis》

发表平台:Frontiers in Big Data

摘要

本文介绍了一种新的条件表格生成对抗网络(CTAB-GAN+),旨在生成高质量的合成数据,同时提供严格的隐私保护。CTAB-GAN+通过添加下游损失来提高合成数据的效用,使用Wasserstein损失和梯度惩罚来改善训练收敛性,并引入了针对混合连续-分类变量和不平衡数据的新编码器。此外,CTAB-GAN+使用差分隐私随机梯度下降(DP-SGD)进行训练,以确保隐私保护。实验结果表明,CTAB-GAN+在多个数据集和学习任务中,能够在给定的隐私预算下,将机器学习效用(如F1分数)提高至少21.9%。

原标题:《5G-Spector: An O-RAN Compliant Layer-3 Cellular Attack Detection Service》

引言:5G-S PECTOR的研究背景与意义

在当今信息时代,随着移动通信技术的快速发展,第五代(5G)蜂窝网络以其高速率、低延迟和高密度连接特性,正在逐步成为未来通信基础设施的核心。然而,这种先进技术也面临着一系列安全挑战。如何确保5G网络的安全性成为了亟待解决的问题。为应对这些挑战,研究团队开发了名为5G-S PECTOR的新型安全解决方案。

随着移动互联网和物联网技术的发展,5G网络连接的数量急剧增加,这使得攻击者有更多的机会进行各类网络攻击。此外,5G网络采用了更复杂的协议和加密机制,但这也增加了安全分析和防御的难度。例如,在5G RAN中,控制面与用户面分离(CUPS)架构为数据处理提供了灵活性,但也带来了潜在的安全隐患。再如,由于5G采用软件定义网络(SDN)和网络功能虚拟化(NFV),动态部署和管理网络服务变得更加便捷,但这同时也增加了系统复杂性,从而给安全防护带来挑战。

在数据隐私日益重要的今天,如何在保护数据隐私的前提下进行数据交集操作成为了学术界和工业界共同关注的焦点。其中,两方私有集合交集(Private Set Intersection, PSI)作为一种重要的密码学应用,允许两个参与方在不知道对方完整集合的情况下,共同计算出双方集合的交集。本文将深入解读由梁之源等人撰写的论文《Benchmark of Two-party Private Set Intersection》,探讨PSI的基本概念、技术原理、应用场景以及最新进展。

一、PSI的基本概念

PSI的核心目标是允许两个参与方(通常称为发送方和接收方)在保护各自数据隐私的前提下,共同计算出它们集合的交集。在这个过程中,双方均不会了解到交集之外的其他信息。这种隐私保护特性使得PSI在许多场景中都具有广泛的应用价值。

原论文标题:《Chatbots in science: What can ChatGPT do for you?》

hatGPT 于 2022 年 11 月推出,震惊了世界。由位于加利福尼亚州旧金山的 OpenAI 创建的人工智能 (AI) 聊天机器人由大型语言模型 ( LLM ) 提供支持,并根据互联网上发布的大部分文本进行训练,使通过提供能够回答复杂问题、撰写复杂论文和生成源代码的基于对话的界面,可以广泛获取自然语言处理的最新进展。一个明显的问题是:这一工具如何改进科学?

要有效地使用聊天机器人,您需要良好的提示。这听起来似乎是显而易见的,但当该工具无法回答一个不清楚的问题时,我的一些同事仍然会感到沮丧并放弃。这是可以理解的:公众一直被这些模型“智能”的想法轰炸,因此认为他们应该理解你提出的任何问题是有道理的。但事实并非如此,这就是为什么即时工程已成为该领域快速发展的学科。

论文原文标题:《GOGGLE: GENERATIVE MODELLING FOR TABULAR DATA BY LEARNING RELATIONAL STRUCTURE》

这篇论文介绍了一种名为GOGGLE的深度生成模型,用于学习和利用表格数据中的关系结构以更好地建模变量依赖,并通过引入正则化和先验知识来提高模型性能。与传统的完全连接层不同,该方法使用消息传递机制,能够捕捉稀疏、异构的关系结构。实验结果表明,该方法在生成真实样本文本方面表现良好,并且可以有效地应用于下游任务中。

!GOGGLE: GENERATIVE MODELLING FOR TABULAR DATA BY LEARNING RELATIONAL STRUCTURE

论文方法

方法描述.本文提出了一种基于关系结构的生成模型——GOOGLE(Graph-guided Generative Modeling for Omitted Variable Leverage)。该模型利用学习到的关系结构来指导生成过程,并通过信息传播的方式处理依赖于其他变量的变量。具体来说,模型包括两个主要组件:可学习的关系结构和基于消息传递神经网络的生成模型。关系结构表示为一个加权无向图,其中节点是随机变量,边表示它们之间的依赖关系。生成模型使用消息传递机制在图上执行多轮信息传播,以确定每个变量的值。最后,模型将噪声向量作为输入,通过生成模型生成数据样本。

论文原文标题:《Local Differentially Private Heavy Hitter Detection in Data Streams with Bounded Memory》

本文介绍了一种名为HG-LDP的新框架,旨在实现在有限内存空间内准确检测数据流中的前k个高频项,并提供严格的本地差分隐私保护。该框架解决了传统LDP技术在处理大数据集和内存限制时存在的“准确性、隐私性和内存效率”之间的不良权衡问题。通过设计新的LDP随机化方法,该框架能够有效地应对大规模项目域和内存空间受限的问题。实验结果表明,与基准方法相比,该框架能够在保证高精度的同时节省2300倍的内存空间。该框架的代码已经公开发布。

论文方法

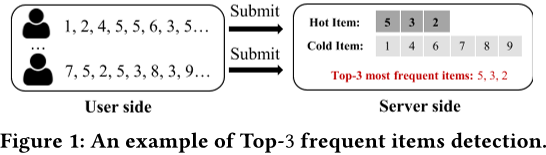

方法描述。该论文提出了一种名为HG-LDP的框架,用于在数据流中跟踪Top-k项并保证用户隐私。该框架包含三个模块:随机化模块、存储模块和响应模块。随机化模块位于用户端,用于随机化用户的敏感数据;存储模块和响应模块位于服务器端,其中存储模块使用空间节省的数据结构。具体来说,使用HeavyGuardian(HG)数据结构来存储随机化的数据,并根据指数衰减策略更新计数。响应模块负责从HG中获取热门项目及其相应的计数,并将其映射到发布列表中,在发布之前对所有计数进行偏差校正。

论文原文标题:《Not Just Summing: The Identifier or Data Leakages of Private-Join-and-Compute and Its Improvement》

本篇论文探讨了在隐私保护下进行数据交互的问题,并针对Google提出的Private-Join-and-Compute库中存在的一些安全漏洞进行了分析和改进。具体来说,该库中的PIS协议和Reverse PIS协议在输入数据结构和处理过程中可能存在用户标识符泄露的风险。为了解决这些问题,本文提出了基于差分隐私技术的改进PIS协议,并对开源库进行了优化。通过使用Tamarin工具进行形式化分析和安全性证明,本文证明了改进后的PIS协议能够成功抵御已知攻击,并且不会带来明显的额外开销。